Stamattina, prima di sedermi a scrivere questo articolo, ho usato l’intelligenza artificiale tre volte.

La prima volta per revisionare un’email di un cliente in modo da essere più chiara e professionale di quanto avrei saputo fare da solo. La seconda volta per analizzare le statistiche di una campagna di marketing digitale e identificare pattern che avrei impiegato ore a trovare manualmente. La terza volta per creare un’immagine da usare per un post di Instagram.

Tre usi. Trenta minuti totali. Risultati che senza l’AI avrebbero richiesto metà della mia giornata.

Lo dico perché questa è la realtà concreta in cui lavoro ogni giorno. Sono un social media manager e web marketer. L’intelligenza artificiale è entrata nella mia vita professionale non come teoria ma come strumento quotidiano, concreto, efficace in tanti aspetti. La conosco dal di dentro, con i suoi limiti, le sue “allucinazioni”, le sue capacità straordinarie e le sue inquietanti implicazioni.

Ed è proprio questa doppia prospettiva: di chi usa l’AI ogni giorno nel lavoro e di chi serve in una chiesa cristiana, che mi ha spinto a scrivere questa serie di articoli. Non per demonizzare la tecnologia. Non per abbracciarla acriticamente. Ma per fare quello che ogni cristiano è chiamato a fare davanti a ogni realtà culturale significativa: capirla, discernerla e risponderle con saggezza.

Prima però, dobbiamo fare un passo indietro. Prima di parlare di pericoli e opportunità, di privacy e transumanesimo, dobbiamo rispondere a una domanda fondamentale: Che cosa è, concretamente, l’intelligenza artificiale?

Una tecnologia già presente

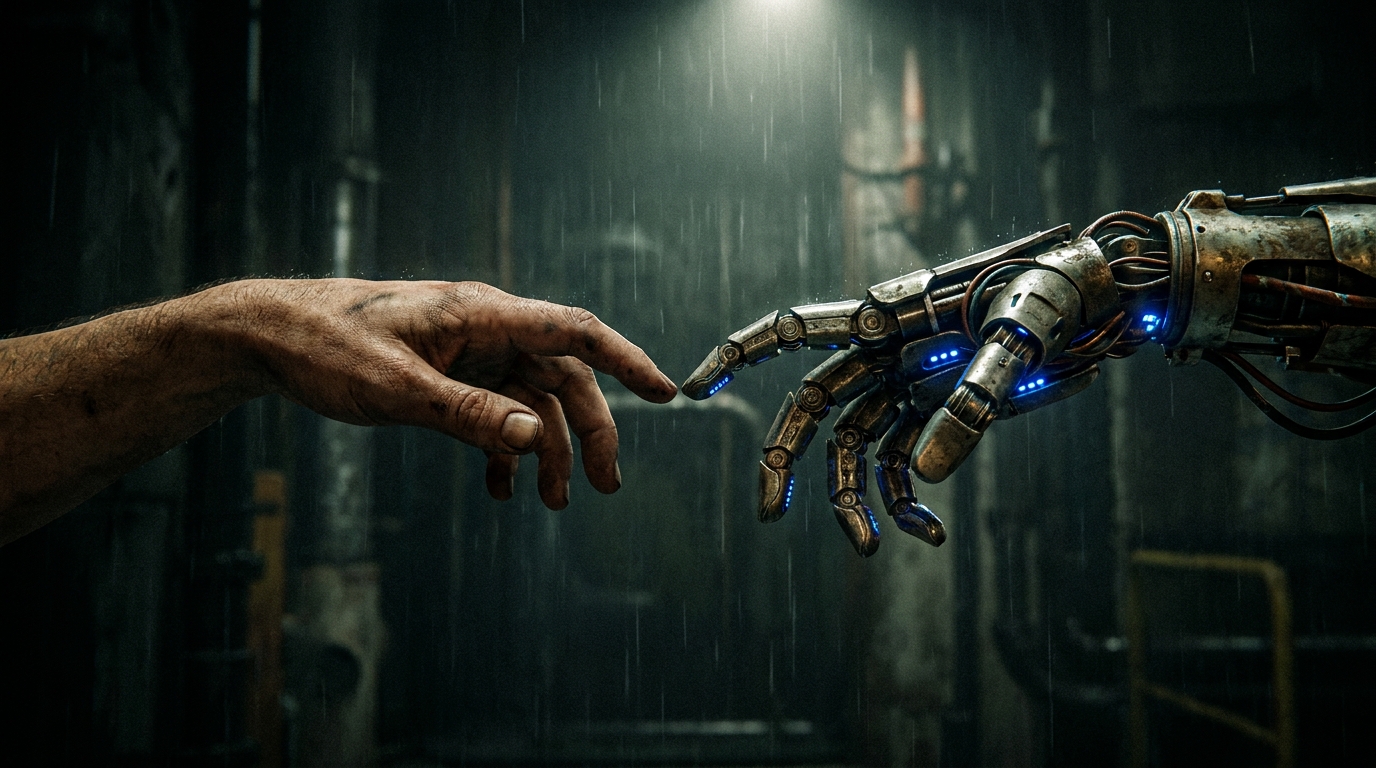

Il termine intelligenza artificiale evoca immediatamente immagini di fantascienza: robot umanoidi, computer che decidono di dominare il mondo, cervelli elettronici che sfidano la coscienza umana. Queste immagini, alimentate da decenni di film e romanzi, hanno fatto più danno che bene alla comprensione pubblica di ciò che l’AI è davvero.

La realtà è molto più vicina, molto meno drammatica, e in un certo senso molto più preoccupante proprio per questo.

Sean O’Callaghan e Paul Hoffman, nel loro libro AI Shepherds and Electric Sheep offrono un’immagine efficace: immaginate l’AI come una galassia di applicazioni. Vista da lontano, sembra tutta uguale. Ma quando ci avvicini con un telescopio, vedi configurazioni molto diverse, con dinamiche profondamente differenti tra loro. L’AI non è una cosa sola. Un universo di strumenti che condividono una tecnologia di base ma si manifestano in forme radicalmente diverse.

Cosa hanno in comune tutte queste forme? Tre elementi: usano grandi quantità di dati, imparano da quei dati attraverso processi chiamati machine learning e deep learning, e applicano ciò che hanno imparato per risolvere problemi specifici.

Il filtro antispam della tua email è AI. L’algoritmo che decide cosa mostrati su Instagram è AI. La funzione di riconoscimento vocale del tuo smartphone è AI. Il sistema che ti suggerisce il percorso più veloce su Google Maps è AI. Il chatbot che risponde alle tue domande sul sito della banca è AI. Il programma che i medici usano per identificare anomalie nelle TAC è AI.

Eri già immerso nell’intelligenza artificiale molto prima di aprire ChatGPT o simili.

Come funziona davvero

Per capire perché l’AI moderna è qualitativamente diversa da tutto ciò che l’ha preceduta, Stephen Driscoll, nel suo libro Made in Our Image, racconta la storia di due confronti storici tra uomini e macchine.

Il primo è il 1997. Gary Kasparov, il più grande scacchista del XX secolo, perde contro Deep Blue, il computer costruito da IBM. Per molti è un momento scioccante. Ma quando lo si analizza tecnicamente, il mistero svanisce. Deep Blue non era intelligente. Valutava duecento milioni di possibili mosse al secondo e massimizzava la probabilità di vittoria. Era, come Kasparov stesso scrisse: ”intelligente come la tua sveglia programmabile”. Non capiva il gioco. Lo calcolava.

Il secondo confronto è il 2016. Lee Sedol, il più grande giocatore mondiale di Go (un gioco antico cinese di una complessità esponenzialmente superiore agli scacchi) perde quattro a uno contro AlphaGo, il sistema sviluppato da DeepMind. Ma questa volta qualcosa di fondamentalmente diverso è accaduto.

AlphaGo non era stato programmato da esperti umani. Era stato addestrato su migliaia di partite, aveva imparato i principi del gioco da solo, e poi aveva applicato quella comprensione in modo creativo. La mossa numero 37 della seconda partita, che i commentatori definirono inizialmente un errore, si rivelò essere la mossa perfetta. Una mossa che nessun essere umano aveva mai giocato. Una mossa che AlphaGo aveva inventato.

Questa è la differenza che cambia tutto. Non più calcolo bruto, ma apprendimento profondo. Non più esecuzione di istruzioni programmate, ma capacità di estrarre principi dai dati e applicarli creativamente in contesti nuovi. Jason Thacker, in The Age of AI, descrive l’AI come “intelligenza non biologica, in cui una macchina è programmata per raggiungere obiettivi complessi applicando la conoscenza al problema”.

Da AlphaGo a ChatGPT: la rivoluzione generativa

Se AlphaGo nel 2016 ha ridefinito cosa le macchine possono fare con i dati, ChatGPT nel 2022 ha ridefinito cosa le macchine possono fare con il linguaggio.

L’AI generativa funziona in modo diverso dai sistemi precedenti. Non è programmata per fare una cosa specifica. È addestrata su quantità immense di testo, immagini, audio (praticamente tutto ciò che l’umanità ha prodotto e digitalizzato) e impara a generare nuovi contenuti statisticamente coerenti con ciò che ha assorbito. Quando gli scrivi un prompt, il sistema predice quale parola dovrebbe venire dopo l’altra, tenendo conto del contesto, del tono, dell’intenzione apparente della tua richiesta. Il risultato è qualcosa che sembra pensiero. Qualcosa che sembra comprensione. Qualcosa che, ed è qui che le cose si fanno teologicamente interessanti, può sembrare saggezza.

Ma non lo è. Non ancora, e credo mai nel senso pieno del termine. L’AI generativa ha quello che i tecnici chiamano il problema delle allucinazioni: quando non conosce la risposta, invece di dire “non lo so”, genera qualcosa di plausibile ma falso, con la stessa sicurezza con cui genererebbe qualcosa di vero. È creativa senza essere cosciente. È convincente senza essere responsabile.

L’uso e l’abuso: dove siamo adesso

Le applicazioni dell’AI oggi coprono ogni dominio dell’esistenza umana. In medicina, i sistemi AI diagnosticano tumori nelle immagini radiologiche con precisione superiore a quella di molti radiologi, rilevano problemi cardiaci attraverso gli smartwatch prima che il paziente li avverta, accelerano la scoperta di nuovi farmaci analizzando miliardi di combinazioni molecolari. Nell’istruzione, personalizzano i percorsi di apprendimento per studenti con esigenze diverse. Nella finanza, gestiscono mercati azionari in frazioni di secondo.

Tutto questo è reale, documentato, in corso.

Ma l’abuso è altrettanto reale. Quarantasette governi, come documentano O’Callaghan e Hoffman, hanno usato nel 2023 l’AI per manipolare le discussioni pubbliche online. I sistemi di riconoscimento facciale vengono usati da regimi autoritari per tracciare e perseguitare i dissidenti. Gli algoritmi di profilazione psicologica vengono usati per manipolare il comportamento politico di tantissimi cittadini ignari. L’AI genera immagini false, video falsi, audio falsi con una qualità che rende presto quasi impossibile la distinzione dall’originale. Il mercato delle fake news è stato moltiplicato per mille dall’AI generativa.

Uso e abuso. Dono e tentazione. Strumento e idolo. La stessa tecnologia che può accelerare la traduzione biblica in lingue mai raggiunte dal Vangelo può costruire sistemi di sorveglianza di massa. La stessa AI che aiuta a diagnosticare precocemente un cancro può essere usata per manipolare un’elezione.

Da dove vengono le riflessioni di questa serie

Gli articoli che compongono questa serie non nascono da una lettura superficiale delle notizie né da reazioni emotive alla tecnologia. Nascono dalla lettura attenta di tanti articoli tecnici e teologici, riflessioni e tre libri che, insieme, offrono la prospettiva più completa e teologicamente fondata che ho trovato su questo tema.

Il primo è Made in Our Image di Stephen Driscoll, pubblicato nel 2024 da Matthias Media. Driscoll è un credente australiano con un background tecnico nella AI. Il suo libro guarda l’AI attraverso il quadro teologico della creazione, del peccato, della croce e della nuova creazione.

Il secondo è The Age of AI: Artificial Intelligence and the Future of Humanity di Jason Thacker, pubblicato da Zondervan nel 2020. Thacker lavora nell’ambito dell’etica tecnologica per la Southern Baptist Convention e porta una prospettiva evangelica rigorosa e documentata, con particolare attenzione alle implicazioni per la famiglia, la chiesa e la dignità umana.

Il terzo, il più recente e il più specificamente orientato al ministero pastorale, è AI Shepherds and Electric Sheep: Leading and Teaching in the Age of Artificial Intelligence di Sean O’Callaghan e Paul Hoffman, pubblicato da Baker Academic nel 2025. È scritto da due teologi-educatori e affronta direttamente le implicazioni dell’AI per chi guida e insegna nella chiesa.

Perché è urgente parlarne in chiesa

C’è una frase nel libro di O’Callaghan che torna in mente ogni volta che penso alla risposta della chiesa all’AI: “Il futuro sta arrivando, e voi non ci siete dentro”.

La chiesa ha spesso risposto alle rivoluzioni tecnologiche con due reazioni opposte e ugualmente inadeguate: il rifiuto totale e l’abbraccio acritico. Abbiamo guardato con sospetto la televisione mentre riempiva le nostre case. Abbiamo abbracciato i social media senza fare domande, e ora raccogliamo i cocci di chiese cristiane polarizzate da algoritmi che non abbiamo capito.

Non possiamo permetterci di ripetere lo stesso errore con l’AI, una tecnologia che è più pervasiva e più potente di qualsiasi cosa abbiamo incontrato prima.

Le domande che questa serie di articoli cerca di affrontare non sono domande tecniche. Sono domande umane. Sono domande pastorali. Chi siamo noi come esseri umani creati a immagine di Dio, e cosa succede a quell’immagine quando una macchina può fare quello che pensavamo facessimo solo noi? Come proteggiamo la dignità di chi ci è affidato in un mondo in cui gli algoritmi profilano le loro vulnerabilità per sfruttarle? Come formiamo discepoli di Cristo in un ambiente progettato per formarci a immagine del consumatore perfetto?

La prospettiva teologica di fondo

Tutto ciò che segue in questa serie parte da un presupposto teologico che voglio rendere esplicito fin dall’inizio, perché determina ogni valutazione successiva.

L’intelligenza artificiale non è né salvatore né demonio. È uno strumento. Come ogni strumento porta in sé le contraddizioni della condizione umana peccaminosa. Può essere usata per il bene e per il male. Può riflettere la gloria dell’immagine di Dio che si esprime nella creatività e nell’ingegno, e può essere pervertita dall’idolatria e dall’arroganza che cercano di sostituire il Creatore con la creazione. Non cadiamo però nell’errore di credere che certi sistemi siano “neutrali”.

Il quadro interpretativo che useremo è quello che O’Callaghan e Hoffman chiamano “narrativa creazionale”: creazione, disintegrazione, liberazione, ricreazione, glorificazione. L’AI va valutata alla luce di questa storia, la storia che Dio sta scrivendo per il mondo e per l’umanità. Dove l’AI serve quella storia, va accolta con gratitudine e discernimento. Dove la ostacola o la deforma, va riconosciuta come pericolo e resistita.

Non è una posizione di paura. È una posizione di fede.

Perché la storia non finisce con AlphaGo né con ChatGPT né con qualsiasi super-intelligenza futura che gli ingegneri di Silicon Valley stanno costruendo. Finisce con Gesù, il re, che ritorna per fare nuove tutte le cose. Quella certezza ci dà la libertà di guardare ogni strumento con occhi aperti, menti lucide e cuori radicati in qualcosa che nessuna macchina potrà mai replicare.

Iniziamo.

ARTICOLO 1: Fatti a Sua Immagine o alla nostra?

Dio ci benedica,

Antonio Morra